「部長、これって情シスに申請しないといけないんですか?」

ある現場でそう聞いてきた若手の担当者は、スマホのメモアプリで顧客リストをAIに貼り付けて分析していた。悪意はゼロ。ただ便利だったから使っていた。

トヨタで22年、製造現場の改善活動をやってきたぼくには、この光景がとても懐かしく、そして怖く見えた。工場で言えば、品質管理部門を通さずに各ラインが勝手に部品を変えている状態と同じなんです。

これが「野良AIエージェント」の正体。悪意じゃなく、善意と利便性から生まれてくる。だから、余計に厄介なんです。

2026年、企業のAI導入が加速する中で、こうした統制外のAIエージェントがセキュリティリスク、コスト浪費、コンプライアンス違反につながるケースが急増しています。ある大手製造業では、営業部門が無断で導入したAIエージェントが顧客データを外部クラウドに保存していたことが判明し、対応に数千万円かかったという話もある。

この記事では、ぼくがippoのコンサル現場で実際に目にしてきた事例をもとに、AIエージェントの乱立に対する「3つの打ち手」を整理しました。情シス部門、経営層、事業部門、どこにいる方でも今日から動けるレベルで書いています。一緒に考えていきましょう。

「野良AI」って何?─工場で言えばこういうことです

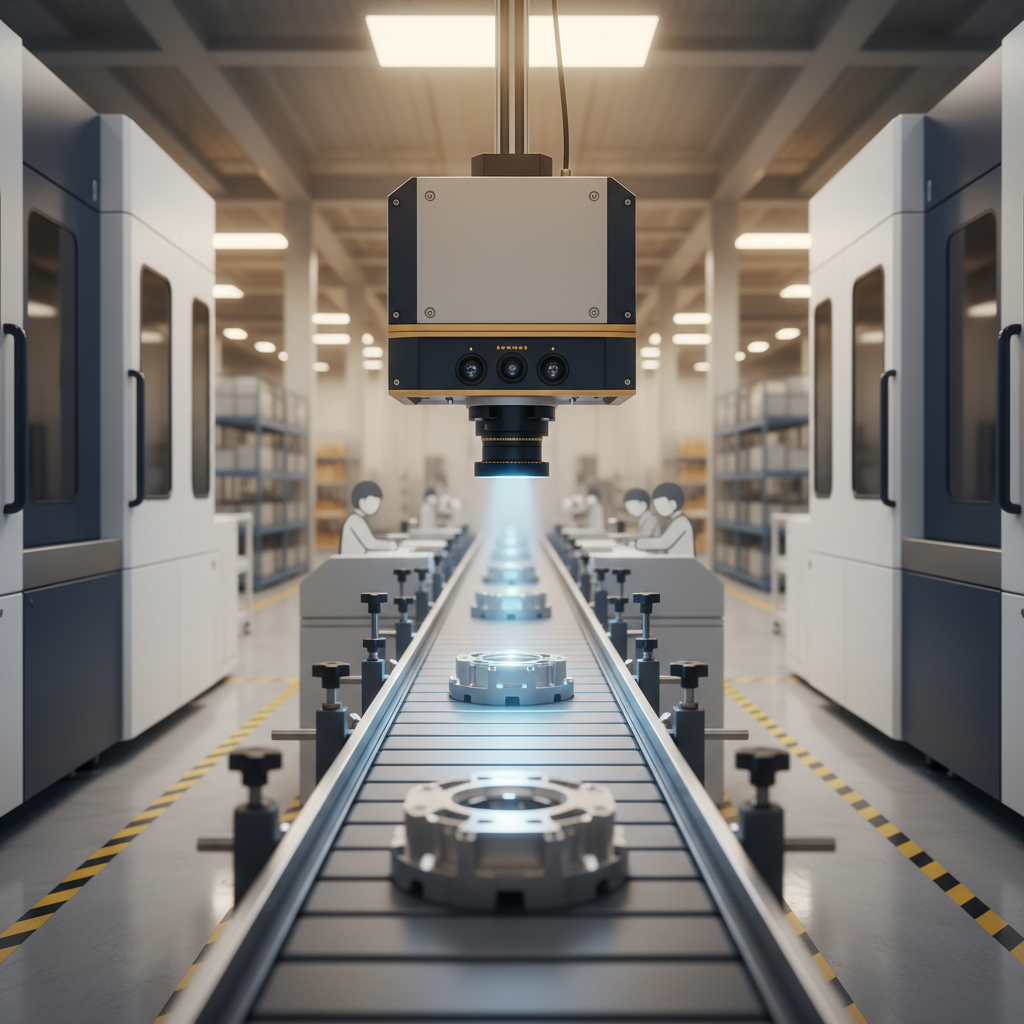

野良AIエージェント(Unmanaged AI Agent)とは、企業の正規なIT資産管理の外で、個別部門や個人が導入・運用しているAIツールやエージェントシステムのことです。

情報システム部門を通さずに導入されるため、セキュリティ審査、ライセンス管理、データ保護ポリシーが及ばない状態になります。工場で言えば、品質管理部門を素通りして各ラインが自由に部品を変えているようなもの。現場はよかれと思ってやってるんだけど、全体で見ると大問題になっている。

2026年現在、この問題が急速に広がっているのは理由があります。ChatGPT、Claude、Gemini BusinessといったSaaS型のAIツールが、月数千円から数万円で手軽に始められるようになった。予算承認プロセスを飛ばせる金額なんですよね。だから、現場が勝手に動いてしまう。

ガートナーの調査によれば、企業内で把握されていないSaaS型AIツールは平均44%にも及ぶそうです。つまり、あなたの会社にも今この瞬間、相当な「野良AI」が動いている可能性が高い。

野良AIがもたらす3つのリスク─「知らなかった」では済まない時代

野良AIの危険性は、IT部門の統制問題だけじゃありません。経営、法務、現場オペレーションの全層に影響が出てきます。

リスク1:情報が、気づかないうちに外に出ていく。営業部門がAIエージェントに顧客データを貼り付けて分析させている場合、その情報が該当AIツールの学習データや外部サーバに保存される可能性があります。

実際に、ある金融企業では営業担当者が顧客の預金残高データを無料版のAIチャットに入力し、GDPR違反で罰金を科せられた。金銭的損失は数億円規模。担当者は「便利だから使っていた」だけなんですよ。だから怖い。

リスク2:監査の時に、説明できなくなる。誰がどのAIツールを使い、何のデータを処理しているかが把握できないと、監査対応や内部統制報告書の作成が本当に困ります。

特に金融機関や医療機関では、規制当局への報告義務があります。野良AIが原因で報告漏れが発生したら、企業の信頼はガタ落ちになる。これは経営問題です。

リスク3:コストが、じわじわ膨らんでいく。各部門が独立してAIツールを契約するため、企業全体でのボリュームディスカウントが利きません。

ある大手メーカーで部門ごとのAI契約費用を集計したら、全社統一契約で実現できる額の約2.3倍に達していた。年間1億円以上が無駄に消えていたわけです。誰も悪意を持っていなかったのに、全体で見ると大損している。製造現場でいう「隠れたムダ」そのものですよね。

なぜ2026年が分岐点なのか

AIガバナンスの必要性は前から言われていましたが、2026年になって緊急度が一段跳ね上がった理由が3つあります。

ひとつ目は、AIエージェントが「待つ存在」から「動く存在」に変わったこと。従来の生成AIは質問に答えるだけの受動的なツールでした。でも2026年現在のエージェント型AIは、自動的に行動を起こします。

社内システムに接続されたAIエージェントが勝手にメールを送ったり、データベースを検索したり、契約書を生成したりする。管理なしにこれが動いていたら、重大な誤動作が起きても気づけない。

ふたつ目は、規制の網が現実のものになってきたこと。EU AI Act、日本の生成AI利用ガイドライン、各業界の規制当局による監視が急速に進んでいます。「知りませんでした」では済まない時代になっています。

みっつ目は、AIが社内システムと深くつながりやすくなったこと。大規模言語モデルと社内システムの統合が技術的に容易になった結果、AIエージェントが社内データに直接アクセスできるようになっています。それだけデータ漏洩のリスクも大きくなった。放置は選択肢にありません。

打ち手1:まず「見える化」する─敵の数を数えることから始める

AIガバナンスの第一歩は「敵を知る」ことです。今、会社の中にどんなAIツールが、どの部門で、何個動いているのか。これを把握しないと何も始まりません。

この可視化フェーズを「AI資産ディスカバリー」と呼んでいて、ippoのコンサルでも必ず最初にやるプロセスです。

やることは3つです。

ステップ1:全社サーベイを実施する。全従業員に「あなたが使っているAIツール、SaaS、アプリは何か」を申告してもらいます。ここで大事なのは「匿名フォームにすること」。これだけで回答率が全然違います。記名式にすると「怒られるかも」と思って隠すんですよね、現場は。

ステップ2:クレジットカードとクラウド支出を洗い出す。経理システムやクラウド請求書から「AI」「Chat」「Agent」などのキーワードで検索して、隠れた支出を見つけます。意外なところから出てきますよ。

ステップ3:ネットワークトラフィックを監視する。SIEMツール(セキュリティ情報イベント管理システム)を使い、社内ネットワークから外部AIサービスへのアクセス状況をログから抽出します。

この3ステップを組み合わせると、隠れていた野良AIの70〜80%を発見できます。実際、ある食品企業でサーベイをやったら、把握していなかったAIツールが約120個出てきた。担当者の顔が青くなっていたのを覚えています。

可視化が終わったら、一覧表にまとめます。記録すべき情報はこれです:利用部門、利用者数、月額費用、処理データの種類、ベンダー情報、全社統一ツールに置き換えられるかどうか。

野良AIが生まれるもう一つの理由は「正規なルートで申請すると時間がかかる」という現場の不満です。これ、製造現場の改善申請でも全く同じ問題が起きる。ルートが複雑すぎると、みんな勝手にやり始める。

だから、導入プロセス自体をシンプルで透明性のあるものに作り直すことが打ち手2の核心です。「遅くない、厳しすぎない」承認フローを設計することがポイントです。

具体的には、AIツールをリスクレベルで3段階に分けます。

レベル1(低リスク):個人データを扱わない、出力が社内限定、月額10万円以下のツール。これは各部門長の判断で即日導入可能にします。現場の自由度を守ることが大事。

レベル2(中リスク):部門データを扱う、複数ユーザーでの共有利用、月額10〜50万円のツール。情報セキュリティ部門の簡易チェック(1営業日以内)を経由して導入を認めます。

レベル3(高リスク):顧客データ、社内システムとの連携、機密情報の処理。CISOと経営層の承認が必要で、詳細な監査とデータ保護対策の設計を行います。

この判定基準は「明確に文書化して、社内全体に周知する」ことが大切です。基準がブラックボックスだと「情シスに頼むより自分でやったほうが早い」という心理が生まれる。透明性が野良AIを減らす一番の薬だと思っています。

さらに、導入後は「最小権限の原則」を守ること。AIエージェントには、その機能に必要な最低限の権限だけを与えます。

たとえば、営業データの分析目的で導入するAIエージェントには、顧客データベースへの「読み取り専用」アクセスだけを許可し、削除や更新の権限は一切与えない。この細かい権限制御が、万が一の時の被害を最小化します。工場の安全設計と同じ考え方ですね。

打ち手3:動かし続けるルールをつくる─予防より「早期発見」で乗り越える

可視化と権限管理が整っても、運用ルールがなければすぐに崩れます。これも製造現場で何度も見てきた光景です。仕組みを作っただけで満足して、気づいたら元の状態に戻っている。

第一の柱は「継続的な監視」です。AIエージェントがどんなデータを処理し、誰がアクセスし、どんな結果を出しているかをリアルタイムで記録します。

AIエージェントのログを中央ログシステムに集約して、異常検知ルールを設定します。「異常なデータ量の処理」「通常と違う利用時間帯」「権限外のアクセス試行」などが検知対象です。

ある金融機関では、AIエージェント経由で1回のクエリに1万件以上の顧客レコードへのアクセスが検知された場合、自動的にアラートが上がり、管理者が確認するまで処理がブロックされる仕組みを導入しています。こういう「自動安全装置」が大事なんですよね。

第二の柱は「四半期ごとの棚卸し」です。全AIエージェントについて定期的にこれをチェックします。

- そのツール、まだ使われてるか?目的に合ってるか?

- セキュリティアップデートは当たっているか?

- 処理対象のデータが決めた範囲に収まっているか?

- ライセンスの使い方は適正か?

- この四半期でインシデントは起きなかったか?

棚卸しの結果、要らないツールは廃止して、統合できるツールは全社標準に置き換えます。テクノロジー部門と事業部門が四半期ごとに対話する場を設けると、AIツールのポートフォリオが自然と健全になっていきます。

第三の柱は「インシデント対応計画」です。万が一、AIエージェントがデータ漏洩や誤動作を起こした時の対応フローを、事前に作っておきます。

発見から報告、原因調査、影響範囲の特定、ステークホルダーへの通知、復旧まで、各ステップの責任者とタイムラインを決めておく。

ここで特に大事なのは「報告の心理的ハードルを下げる」ことです。インシデントが起きた時に「犯人探し」が始まる文化では、隠蔽が起きます。「迅速な報告が会社を守る」というメッセージを経営層が繰り返し発信することが、実はこの仕組み全体を支える土台になります。

ippo導入コンサル事例:ある大手メーカーで起きたこと

少し具体的なイメージを持ってもらうために、ippoのコンサル案件のひとつを紹介します(企業機密保護のため一部変更しています)。

対象は従業員数3,000名の大手自動車部品メーカー。営業部門、製造部門、企画部門がそれぞれ別のAIツール(計15個)を契約していて、月額総費用は約200万円。でも機能の重複や使われていないツールだらけで、「これ、整理しないといけないよね」という状態でした。

フェーズ1(1ヶ月):AI資産ディスカバリー。従業員サーベイ、クレジットカード分析、ネットワークトラフィック監視を並行で実施。結果、公式契約の15個に加えて、個人や部門レベルで入っていたツールが約25個追加で判明しました。担当者の方が「こんなに使われてたんですか…」と絶句していたのが印象的でした。

フェーズ2(2ヶ月):導入承認ワークフローの整備。AIツールをリスクレベルで3分類して、各レベルの承認フローと権限管理ルールを文書化。これをポスターにして全事業所に貼り出し、新人研修にも組み込みました。「見える場所に貼る」というアナログな一手が、意外なほど効きます。

フェーズ3(3ヶ月):統合と運用体制の構築。生き残るツールを9個に絞り込み、月額費用を約200万円から約120万円に削減。同時に、権限管理・ログ監視・四半期監査の体制を一気に整えました。

実施6ヶ月後のフォローアップで確認できた変化はこんな感じです。

- インシデントの報告件数が増加(隠蔽が減って、問題が表に出るようになった)

- AIツール導入申請の平均審査時間が5営業日→2営業日に短縮

- 従業員のAIツール利用満足度が向上(「使っていいものが明確になった」という安心感)

- 情シス部門の負担は一時的に増えたけど、運用自動化で半年後には元の水準に戻った

この企業がうまくいった理由は「厳しすぎず、甘すぎず、基準が明確で、現場の声を聞いた」からだと思っています。野良AIを生む根本原因は、悪意じゃなく「ルールがわかりにくい」「申請が面倒」という現場の小さなストレスです。そこを丁寧に解消したことが、全体を動かしました。

CISOと経営層が今月中にやるべき5つのこと

ここまで読んでくれた情報セキュリティ責任者や経営層の方へ、今月中に動けることをまとめます。難しく考えなくていい。一歩ずつです。

アクション1:経営層から「野良AIは経営リスクだ」と全社に発信する。IT部門だけの問題ではなく、会社の存続に関わる話だと認識を共有する。これがないと、現場は動きません。

アクション2:2週間以内にディスカバリープロジェクトチームを作る。小さくていい。3〜5人でいい。月内にサーベイを開始することを目標にします。

アクション3:30日以内に導入承認ワークフローの暫定版を公開する。完璧じゃなくていい。「明確な基準が存在する」ことが先。その後、四半期ごとに改善します。

アクション4:CISO、法務、事業部長から成る「AIガバナンス推進委員会」を設置する。月1回のミーティングで進捗確認と問題解決を継続します。会議体を作ることで、動き続ける仕組みができます。

アクション5:全従業員向けの教育プログラムを企画する。「なぜAIガバナンスが必要か」を事例を交えて伝える研修を実施します。1時間で十分。現場の人が「なるほど、自分も気をつけよう」と思える内容にすることが大事です。

2027年以降に備えること─ガバナンスは進化し続ける

2026年の3つの打ち手は、あくまで「土台づくり」です。2027年以降は、さらに高度な課題に向き合うことになります。

ひとつ目は「AIエージェント同士が連携する」リスクです。複数のAIエージェントが自動的に連携して処理を実行し、人間の目が一切入らない状態が生まれてきます。エラーや暴走の検出が遅れ、被害が急速に広がる。2027年には「エージェント間通信ログの統合監視」「自動停止トリガー」といった仕組みが必須になるでしょう。

ふたつ目は「AIの判断根拠を説明できること」が義務化される流れです。特に金融や医療では、規制当局から「なぜそう判断したか」を示すことが求められるようになります。AIエージェントの内部動作をロギング・監査できるシステムへの投資が必要です。

みっつ目は「自己進化するAIエージェント」への統制です。ファインチューニングやプロンプト最適化を自動実行するエージェントが増えると、元の設計意図から逸脱する可能性が出てきます。「AIエージェントを統制下に置く」から「進化させながら統制する」というより高度なフェーズに入っていきます。

変化は止まらない。だからこそ、今の土台をしっかり作ることが、将来の挑戦への備えになります。

まとめ─これだけ覚えておいてください

2026年のAIガバナンスは、もはややるかやらないかの選択肢ではありません。野良AIエージェントの乱立は、セキュリティ、コンプライアンス、コストの三方向で企業に損害をもたらします。

- 打ち手1:可視化─社内サーベイ、クレジットカード分析、ネットワーク監視で現状を把握する。隠れたAIは会社の3割以上に存在します。まず数えるところから。

- 打ち手2:権限管理─リスクレベル別の導入承認ワークフローと最小権限の原則で、現場の自由度を守りながら統制を実現する。「遅くない、厳しすぎない」がキーワードです。

- 打ち手3:運用ルール─継続的な監視、定期的な棚卸し、インシデント対応計画で、AIエージェントを生き物として日々管理する。完璧な予防より、早期発見が現実的です。

この3つの打ち手は、ippoを含む複数の企業で実際に機能することを確認しています。あなたの会社にも、今すぐ動ける優先順位があるはずです。まずは今月中に、経営層からの一声とディスカバリープロジェクトの立ち上げを。

トヨタにいた22年間で何度も見てきたことがあります。「問題を見える化したとき、半分はもう解決している」。AIも同じです。野良AIを放置することは、工場のラインに不良品が混じったまま出荷し続けることと変わりません。見えていれば、動ける。一歩ずつ、でいい。

出典・参考情報

- ガートナー『2026年SaaS管理レポート』(2026年)

- 国家情報セキュリティセンター『AI利用企業のセキュリティガイドライン』(2026年)

- EU『AI Act規制強化に関する執行ガイダンス』(2026年)

- 日本生成AI利用ガイドライン検討会『組織向けガバナンス実装マニュアル』(2026年)

- IDC『2026年エンタープライズAI支出予測レポート』(2026年)

用語集

- 野良AIエージェント(Unmanaged AI Agent):企業のIT資産管理の外で、個別部門や個人が導入・運用しているAIツール。セキュリティ審査やコンプライアンス対応が及ばない状態のもの。

- AIガバナンス:企業内のAI利用を統制し、リスクを最小化しながら価値を最大化するための体系的な運営の枠組み。

- ディスカバリー:組織内に存在するAI資産を徹底的に探索・把握するプロセス。

- 最小権限の原則(Principle of Least Privilege):システムやプログラムには、その機能実行に必要な最低限の権限だけを付与する考え方。セキュリティリスクを減らす基本設計思想。

- SIEM(Security Information and Event Management):セキュリティ情報イベント管理システム。ネットワーク内の異常なアクセスやデータ流出を検知するツール。

- GDPR(General Data Protection Regulation):EU一般データ保護規則。個人データ処理に関する厳格な規制法で、違反時は高額罰金が科せられる。

- コンプライアンス:企業が法律や規制、社内ルールに従う姿勢と体制のこと。

- CISO(Chief Information Security Officer):最高情報セキュリティ責任者。企業全体のセキュリティ戦略を統括する経営層ポジション。

- ファインチューニング:既存の学習済みAIモデルを、特定のタスクや企業データに合わせて追加学習させるプロセス。

- インシデント:セキュリティやシステムの問題事象。データ漏洩、不正アクセス、システム障害などが該当する。